Hva er Automatisert optisk inspeksjon?

Automatisert optisk inspeksjon (AOI) er en teknologi som brukes for å automatisk undersøke produkter for å finne feil eller mangler.

Inspeksjonen skjer ved hjelp av spesialiserte kameraer som tar bilder av produktene og programvare som sjekker om de er laget riktig og uten defekter.

AOI brukes mye i produksjonsindustrien.

Om artikkelen

Denne artikkelen presenterer et prosjekt som har hatt som mål å utvikle et interaktivt brukergrensesnitt (IUI) for et Automatisert Optisk Inspeksjon-system.

Prosjektet er et samarbeid mellom SINTEF og Hapro AS.

Det ble gjennomført i to faser:

- En lavkostnads AOI-løsning ble utviklet.

- Et tilpasningsdyktig grensesnitt ble designet (for å gjøre interaksjonen med AOI-systemet sømløst og effektivt for Hapro sine teknikere).

«For å sikre kvaliteten på produkter som produseres i mindre serier, er det viktig å minimere menneskelige feil. I slike produksjonsprosesser benyttes ofte manuell montering, noe som gjør feil mer sannsynlige.

For å redusere denne risikoen ser vi et stort potensial i å bruke rimelige, automatiserte optiske inspeksjonssystemer (AOI)»– Jon Eilert Liane, Hapro AS.

Om prosjektet

Hapro AS hadde behov for en effektiv og fleksibel programmeringsmetode for inspeksjon som dekker et bredt spekter av oppgaver.

Alt fra loddekontroll av hullmonterte komponenter etter en selektiv loddeprosess, til enkel kontroll av tilstedeværelse og posisjonering av komponenter og deler på en mekanisk sammenstillingslinje.

Løsningen måtte baseres på lavkostnadsmaskinvare og ha kort implementeringstid for å sikre konkurransedyktighet både på pris og ressursbruk.

Et AOI-system som ble utviklet i prosjektet består av flere nøkkelkomponenter, inkludert et høyoppløselig kamera, belysningssystemer og en datamaskin, som i dette prosjektet er en Raspberry Pi for bildeprosessering.

Kameraet fanger detaljerte bilder av kretskortene, mens en trent KI-modell analyserer bildene for å avdekke avvik som manglende komponenter, dårlig lodding eller feilplassering.

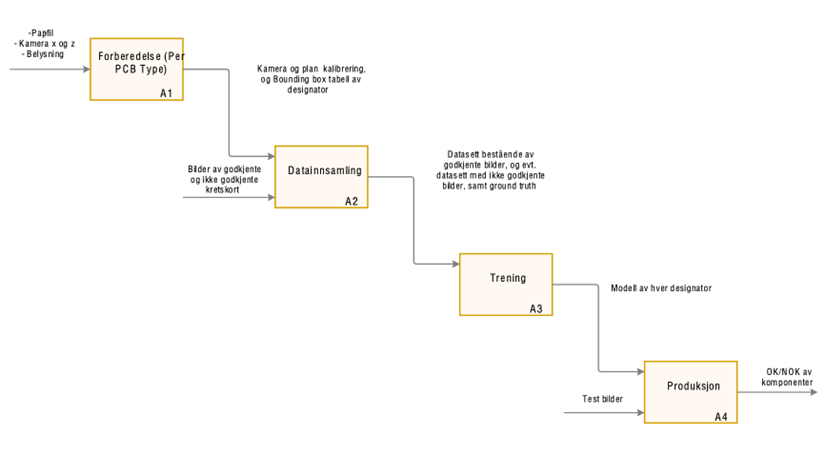

I sin opprinnelige form kunne AOI-systemet kun opereres i en terminalmodus, hvor brukeren måtte følge en forhåndsdefinert oppskrift-fil for å skrive inn nødvendige kommandoer i terminalen og gjennomføre hvert steg i prosessen (figur 1). Dette krevde manuell input og begrenset brukeropplevelsen for teknikerne.

Intelligent brukergrensesnitt for kvalitetssikring av elektromekaniske produkter

«Gjennom testingen av AOI-systemet viste det seg at selv om teknologien fungerer effektivt, trengs det fortsatt løsninger som gjør implementeringen raskere og enklere i produksjonen.

Et mer intuitivt og brukervennlig grensesnitt vil gjøre det lettere for flere ansatte å sette opp og betjene systemet. Dermed kan AOI raskt tilpasses ulike produksjonslinjer og bidra til økt effektivitet.” Jon Eilert Liane, Hapro AS

Prosjektet har som mål å utvikle et intelligent brukergrensesnitt (IUI) for AOI-maskiner, med fokus på å øke brukervennligheten gjennom en effektiv operatør-maskin interaksjon.

Delmålene inkluderer å evaluere hvilke data som skal samles inn og hvordan disse best kan formidles for å maksimere nytteverdien for operatøren. Videre innebærer prosjektet å utvikle et konsept og en programvarearkitektur som støtter et multimodalt grensesnitt.

En prototype av et beslutningsstøttende og tilpasningsdyktig IUI skal realiseres, slik at grensesnittet kan tilpasses ulike operatører og produkter. Til slutt skal nytteverdien av det utviklede IUI for operatører avklares og evalueres.

Brukerundersøkelse

Målet med brukerundersøkelsen var å kartlegge behovet for et intelligent brukergrensesnitt (IUI) til automatisk optisk inspeksjon (AOI).

I eksperimentet ble en deltaker (operatør) plassert ved AOI-boksen og instruert i å lese en oppskrift for hvordan AOI-løsningen skulle settes opp. Først gjennomførte operatøren oppsettet med veiledning, og tiden som ble brukt ble målt som «Opplæringstid».

Deretter gjennomførte operatøren oppsettet på egen hånd, og tiden brukt på å starte treningen av modellene ble målt som «Treningstid». Eksperimentet ble utført med flere operatører i tidsperioden 12.02.2024 til 23.02.2024.

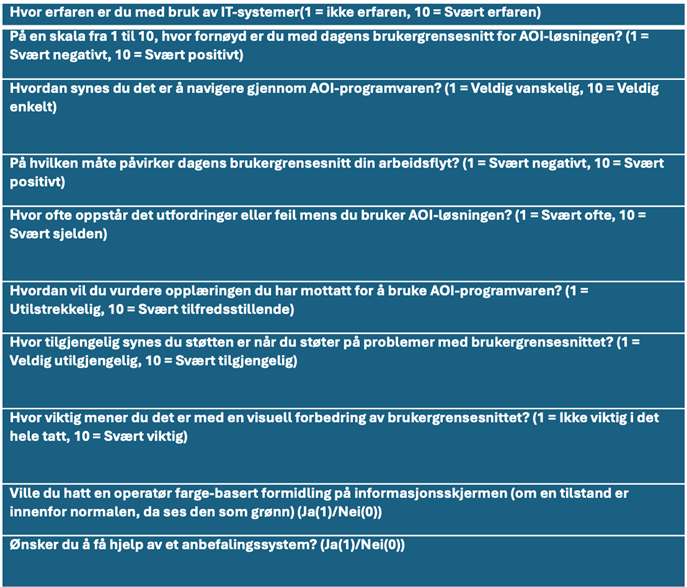

Etter eksperimentet fikk deltakerne en rekke spørsmål (figur 2), som ble brukt til å kartlegge behovet for en forbedret løsning for interaksjonen med AOI-systemet.

Oppsummering av brukerundersøkelsen

Selv om operatørene har erfaring med IT-systemer, er de ikke fornøyde med dagens AOI-løsning, som påvirker arbeidsflyten negativt. Visuelle forbedringer av brukergrensesnittet anses som svært viktig. Operatørene etterspør mer informasjon på skjermen og foretrekker en berøringsskjermløsning for enklere interaksjon. De ønsker ikoner og illustrerte knapper, en sjekkliste for hvert steg i prosessen, samt at bilder vises umiddelbart etter opptak. I tillegg er det et klart behov for støtte og anbefalinger knyttet til justering av fokus og lys for kameraet.

IUI prototype

Målet med det intelligente brukergrensesnittet (IUI) er å forbedre dagens arbeidsflyt ved å erstatte den manuelle oppskriftlisten med et intuitivt og brukervennlig grensesnitt som sikrer en mer sømløs og effektiv operasjon. Gjennom brukerundersøkelsen og påfølgende diskusjoner mellom prosjektdeltakerne ble det identifisert flere utfordringer i den eksisterende løsningen, samt konkrete behov for forbedringer.

Resultatene fra undersøkelsen, kombinert med innspill fra operatørene og prosjektgruppen, la grunnlaget for en detaljert kravspesifikasjon. Denne spesifikasjonen inkluderer prioriterte områder som er avgjørende for å utvikle en velfungerende prototype innen prosjektets tidsramme. Spesifikasjonen omfatter blant annet forbedring av brukergrensesnittets visuelle utforming, integrering av mer interaktiv funksjonalitet, og støtte for rask tilgang til relevant informasjon.

Videre vektlegges bruk av ikoner og illustrerte knapper, umiddelbar visning av bilder, samt verktøy som gir støtte og anbefalinger for optimalisering av fokus og lys til kamera.

Gjennom disse tiltakene er målet å tilby et grensesnitt som ikke bare forenkler arbeidsoppgavene for operatørene, men også forbedrer arbeidsflyten og øker systemets effektivitet. Prototypen vil være et viktig steg mot en mer moderne, brukervennlig og tilpasningsdyktig løsning som møter operatørenes behov og skaper en mer effektiv interaksjon med AOI-systemet.

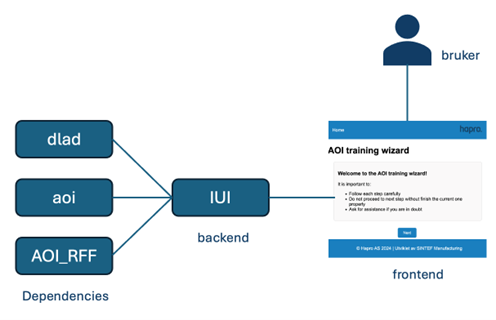

Utviklingen av det intelligente brukergrensesnittet (IUI) (figur 3) er basert på en solid og fleksibel teknisk plattform. Backend er utviklet i Python ved bruk av Flask-rammeverket, mens frontend er implementert med HTML og JavaScript for å sikre en responsiv og brukervennlig opplevelse. Flask er valgt fordi det er et lettvekts rammeverk som krever minimale avhengigheter, noe som gjør det ideelt for mikro-tjenester og små til mellomstore applikasjoner. Dette gjør systemet enkelt å tilpasse til ulike miljøer som utvikling, testing og produksjon. Flask er også kjent for sin fleksibilitet og raske oppsettstid, samtidig som det har et aktivt utviklermiljø med rikelig tilgang til ressurser, omfattende dokumentasjon og tredjepartsutvidelser. Den valgte teknologistakken gir en robust og skalerbar løsning som kan videreutvikles etter behov, samtidig som den holder systemet effektivt og brukervennlig.

Resultater

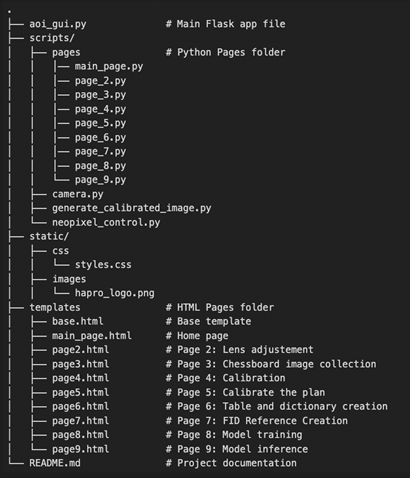

Det intelligente brukergrensesnittet (IUI) består av totalt ni sider, der hver side har et spesifikt formål (figur 4). Grensesnittet er designet for å støtte operatøren gjennom hele prosessen, med et klart fokus på å forenkle arbeidsflyten og forbedre brukeropplevelsen.

Målet med IUI-en er å gi operatøren nødvendig hjelp i prosessen ved å tilby visuelle tilbakemeldinger i sanntid og veiledning for å raskt kunne identifisere og rette eventuelle feil som oppstår. Dette gjør systemet mer intuitivt, reduserer feilmarginer og sikrer en mer effektiv og sømløs interaksjon med AOI-løsningen.

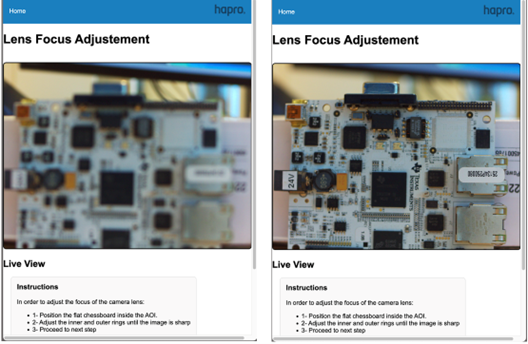

Vi kan se to eksempler på IUI-en under bruk i figur 5 og figur 6. I figur 5 benytter operatøren en direktesending fra AOI-kameraet for å justere både kamerafokus og belysning. Dette gjør at operatøren kan få umiddelbar tilbakemelding i sanntid i form av en video som viser kvaliteten på justeringen. På denne måten kan operatøren kontinuerlig overvåke og finjustere innstillingene for å oppnå optimal bilde.

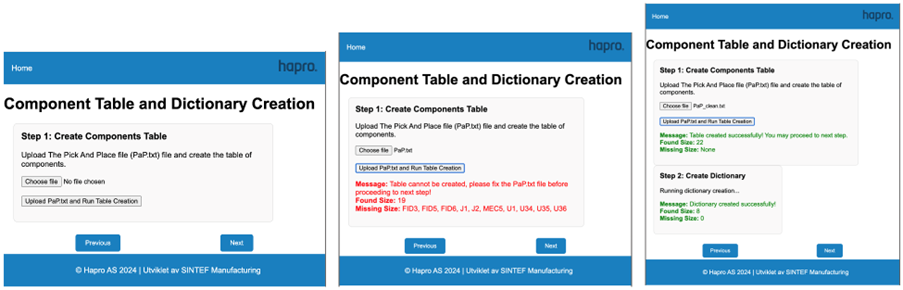

I figur 6 laster operatøren inn en Pick-and-Place (PaP)-fil, som inneholder en liste over komponentene som skal plasseres på kretskortet under treningsprosessen. Dersom PaP-filen inneholder feil, vil IUI-en automatisk påpeke disse feilene og gi beskjed om at de må rettes før videre prosessering kan finne sted. Dette bidrar til å sikre at feil blir identifisert og korrigert på et tidlig stadium, noe som forbedrer nøyaktigheten og effektiviteten i produksjonsprosessen.

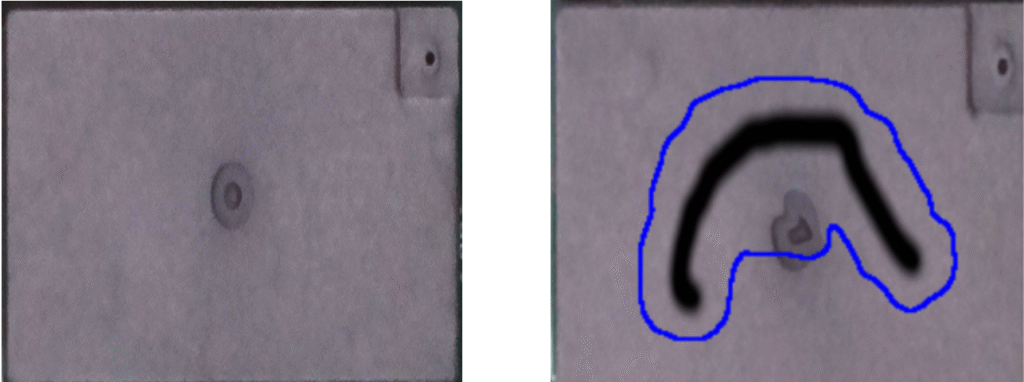

Etter at modellen er trent, kan operatøren utføre modelltesting (inference), der den trente modellen brukes til å identifisere feil på kretskortet. Figur 7 viser et eksempel der man i figur 7.a ser en komponent uten feil, og i figur 7.b en komponent med feil. Her klarte KI-modellen å oppdage feilen og vise hvor den befinner seg.

Konklusjon

Prosjektet har hatt som hovedmål å utvikle en løsning for forbedring av brukerinteraksjon i et spesifikt teknologisk system. Arbeidet har blitt delt inn i flere faser, som hver har fokusert på forskjellige aspekter av systemutviklingen.

Først ble det gjennomført en grundig kartlegging av behovene for en alternativ løsning. Denne fasen innebar innsamling og analyse av eksisterende utfordringer og krav fra brukerne, samt en vurdering av hvordan disse behovene kunne adresseres gjennom ny teknologi eller forbedringer i grensesnittet. Deretter fulgte en omfattende grensesnittarkitektur- og litteraturgjennomgang.

I denne fasen ble det undersøkt eksisterende løsninger og teoretiske tilnærminger innenfor interaktive brukergrensesnitt (IUI) og andre relevante teknologier. Målet var å forstå de beste praksisene og de nyeste trendene, samt å identifisere hvilke metoder og prinsipper som kunne implementeres i prosjektet for å forbedre brukeropplevelsen. Den siste fasen bestod av implementeringen av IUI-prototypen, hvor vi utviklet en interaktiv brukergrensesnittmodell som adresserte de identifiserte behovene og kravene. Denne prototypen ble testet og evaluert for å vurdere dens effektivitet og brukervennlighet i praksis. Gjennom implementeringen ble det også mulig å identifisere potensielle forbedringsområder og justeringer for videre utvikling.

Samlet sett har prosjektet gitt innsikt i hvordan en forbedret IUI kan bidra til en mer effektiv og intuitiv brukeropplevelse, og har lagt grunnlaget for videre arbeid innenfor dette området.

For videreutviklingen av IUI-en er det flere sentrale områder som bør utforskes. Først og fremst bør prototypen optimaliseres gjennom finjustering basert på tilbakemeldinger og brukertesting. Dette vil bidra til å forbedre både funksjonaliteten og brukeropplevelsen. Videre bør det arbeides med integrasjon mot eksisterende systemer for å sikre en sømløs arbeidsflyt, for eksempel gjennom kobling til MPAL (Multi Process Assembly Line) prosjekt eller andre relevante plattformer.

En annen viktig utviklingsmulighet er å utforske avanserte funksjoner som sanntidsanbefalinger og forbedret feildeteksjon ved hjelp av maskinlæringsmodeller som LLM (Large Language Models) eller andre spesifikke feildeteksjonsmodeller.

Til slutt bør det vurderes hvordan IUI-en kan skaleres for å håndtere større produksjonsmiljøer, for eksempel ved å desentralisere trenings- og deteksjonsprosesser eller integrere GPU-baserte serverløsninger for å øke kapasiteten og effektiviteten.

Kommentarer

Ingen kommentarer enda. Vær den første til å kommentere!